🔥 Minimax M1: Китайский ИИ, который учился за $534K — а делает как за $100M

Всего через полгода после триумфа DeepSeek R1 на сцену выходит Minimax M1 — новая open-source модель из Шанхая с контекстом 1 млн токенов и производительностью на уровне GPT-4o и Claude 3. Но главное — её обучение стоило всего $534 000 — в 200 раз дешевле, чем GPT-4o от OpenAI.

Почему это важно для нас? 1️⃣ Бесплатно и открыто M1 выложена в открытый доступ (Apache 2.0) — можно кастомизировать код, встраивать в свои продукты, учить на своих данных.

2️⃣ Создаёт сложные проекты «в один клик» Пишет чистый код, строит работающие сайты (например, виртуальный тур по Индии) с картами, API и логикой.

3️⃣ Экономит ресурсы Благодаря архитектуре Mixture-of-Experts и «молниеносному вниманию» (Lightning Attention) тратит на 75% меньше вычислений, чем аналоги.

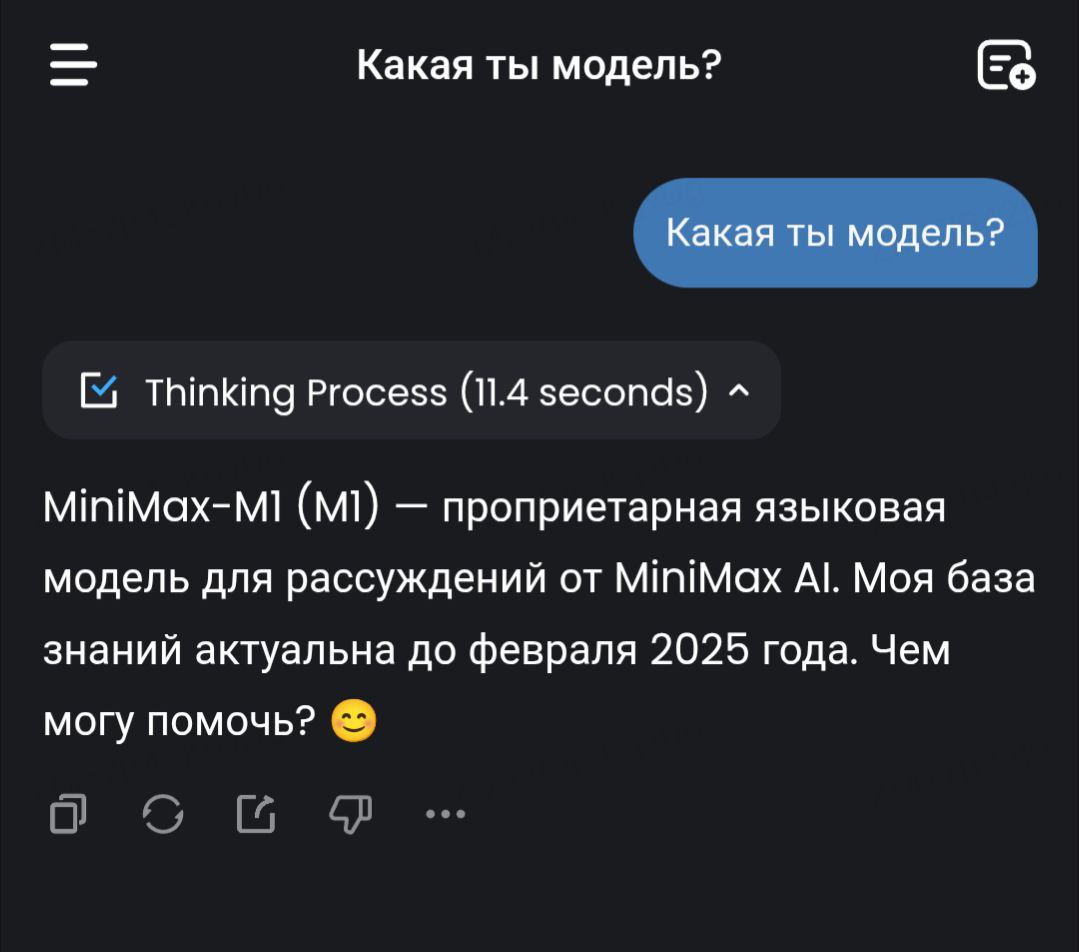

4️⃣ Уже работает Доступна в двух версиях:

- M1-40K — для стандартных задач;

- M1-80K — для сложной аналитики и агентных сценариев.

👉 Англоязычный разбор — в статье VentureBeat: Minimax M1: Open-Source Model with 1M Token Context

💡 Фишка поста: M1 не просто «ещё одна модель» — это доказательство, что дорогой ИИ — не значит лучший. Китайские стартапы бросают вызов гигантам вроде OpenAI, снижая порог входа в ИИ для всех.

#Minimax #ИИ #OpenSource #Китай #GPT

Пробуем здесь.