Встречайте, Kimi K2 от Moonshot AI 🇨🇳

🤯 Что за зверь? Это MoE-модель на триллион (!!!) параметров, из которых 32 миллиарда — активные. Архитектура основана на DeepSeek V3, но с важными доработками. Kimi K2 — это так называемая "агентная" модель. Говоря по-простому, это не просто болталка, которая генерит вам текст по запросу, а модель, которая может действовать: анализировать данные, писать и запускать код, исправлять ошибки, работать с инструментами.

В официальном блогпосте есть шикарный пример: модели дают задачу проанализировать данные по зарплатам, найти зависимости, построить графики и в конце сверстать HTML-страничку с результатами и интерактивным калькулятором. Kimi K2 последовательно выполняет 13 шагов в IPython, чтобы получить готовый результат.

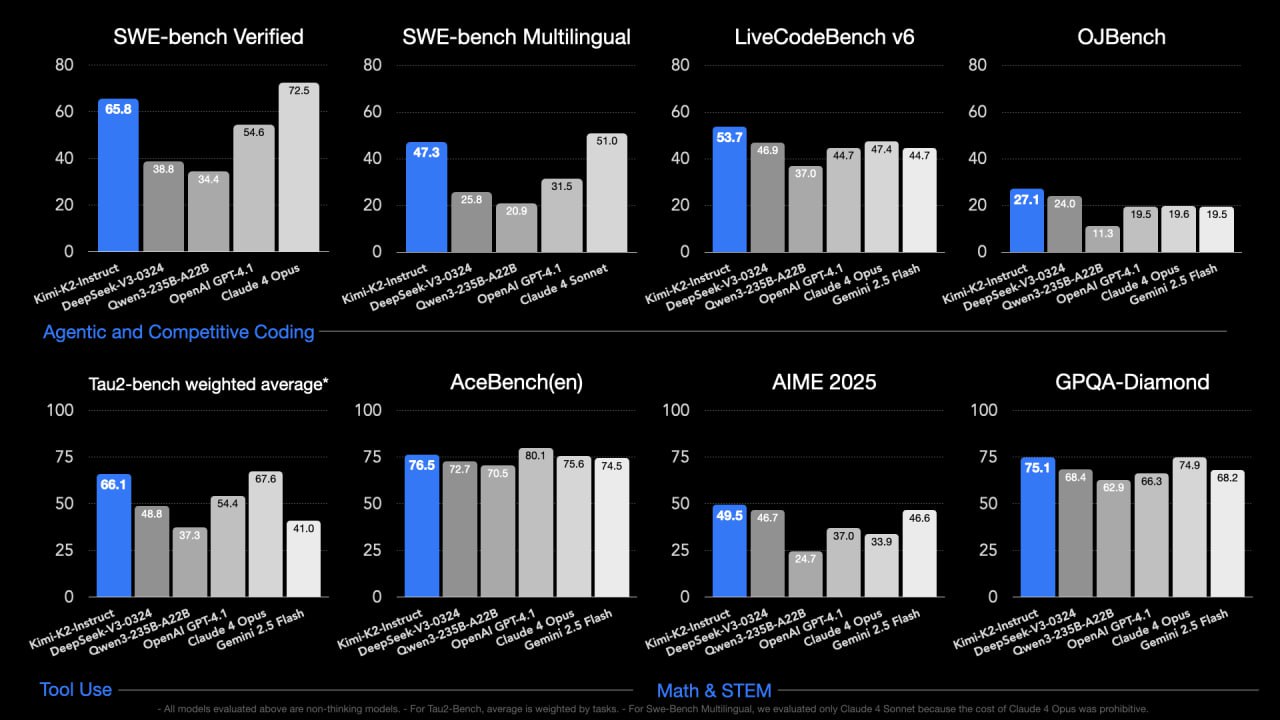

И что по бенчмаркам? В задачах на программирование (бенчмарк SWE-bench) эта модель, работая в "рефлекторном" режиме (без долгого обдумывания), обходит Claude 4 Sonnet и даже GPT-4.1. И это, напомню, открытая модель, которую можно развернуть у себя.

🤖 А что под капотом? Китайские инженеры не просто скопировали архитектуру. Они использовали модифицированный оптимизатор MuonClip, который позволил им провести тренировку на 15.5 триллионах токенов с нулевой нестабильностью. Никаких "лосс спайков", которыми так славятся большие модели. Чистая, стабильная тренировка.

Ну и главное — деньги. API у них стоит смешных денег по сравнению с конкурентами:

- $0.60 за миллион входных токенов

- $2.50 за миллион выходных токенов

Это почти в 5 раз дешевле, чем условный Claude 4 Sonnet.

Ссылочки