Не все внимание одинаково ценно.

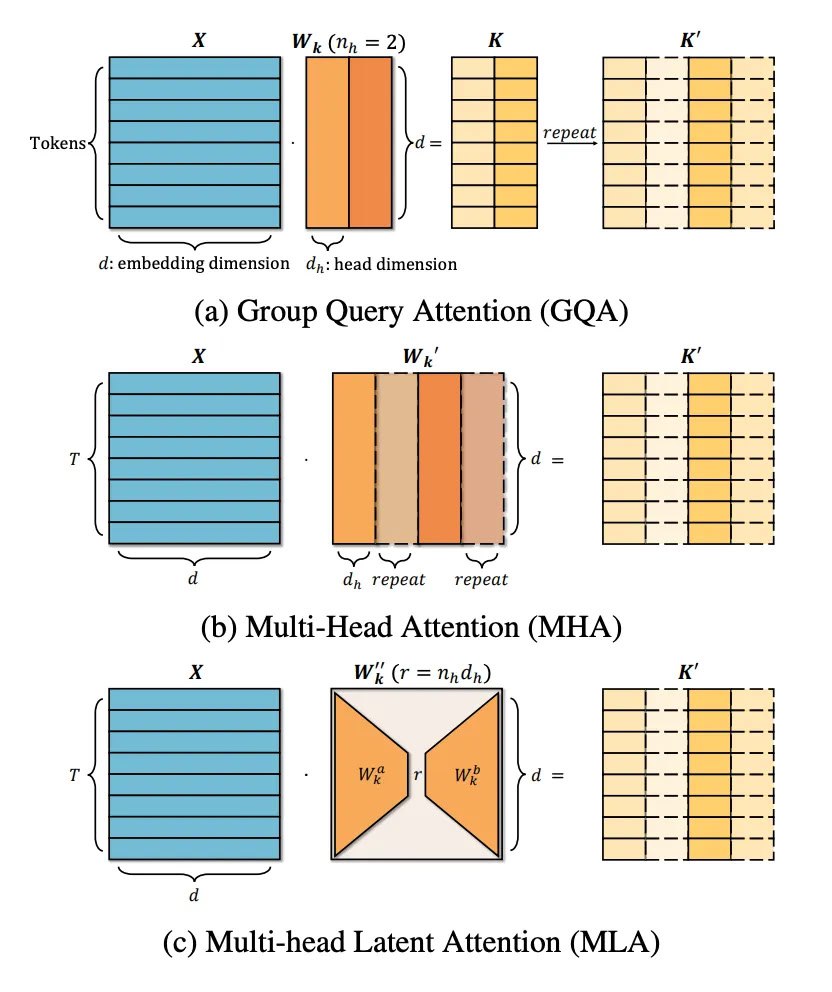

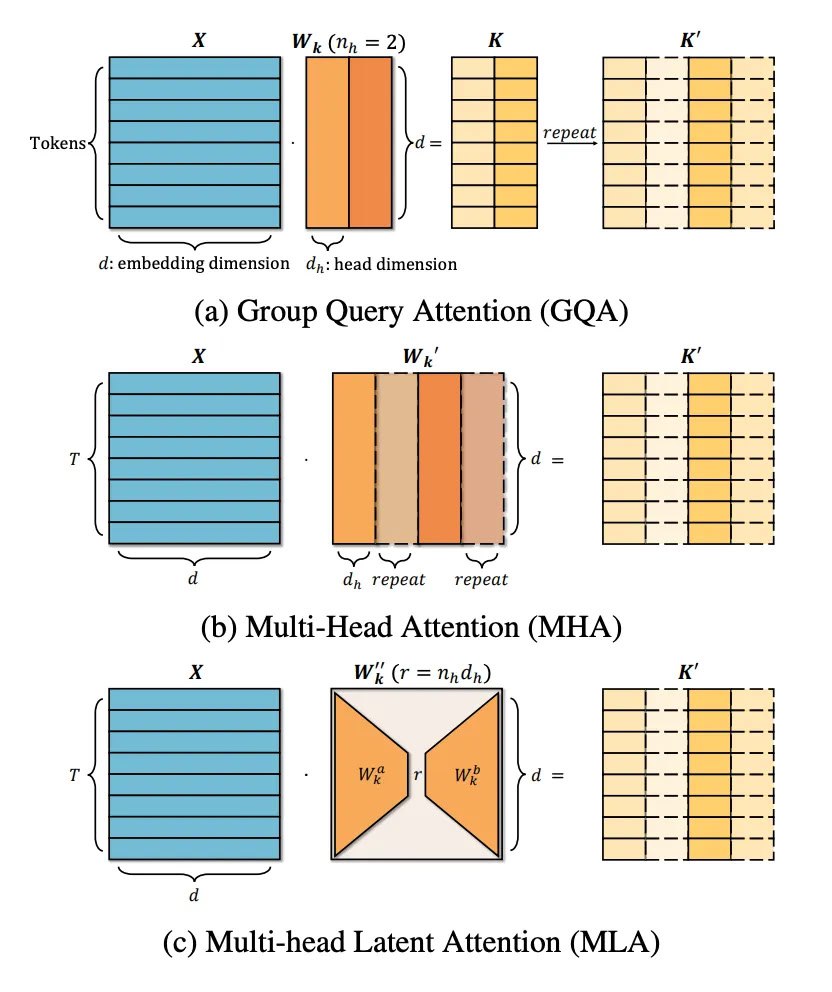

Стандартное многоголовое внимание (Standard Multi-Head Attention) мощное, но затратное.

Grouped-Query Attention (GQA) — это более разумная эволюция.

Важно сбалансировать производительность и эффективность для создания более быстрых LLM.