Скрытые предвзятости LLM: чью жизнь ИИ ценит выше

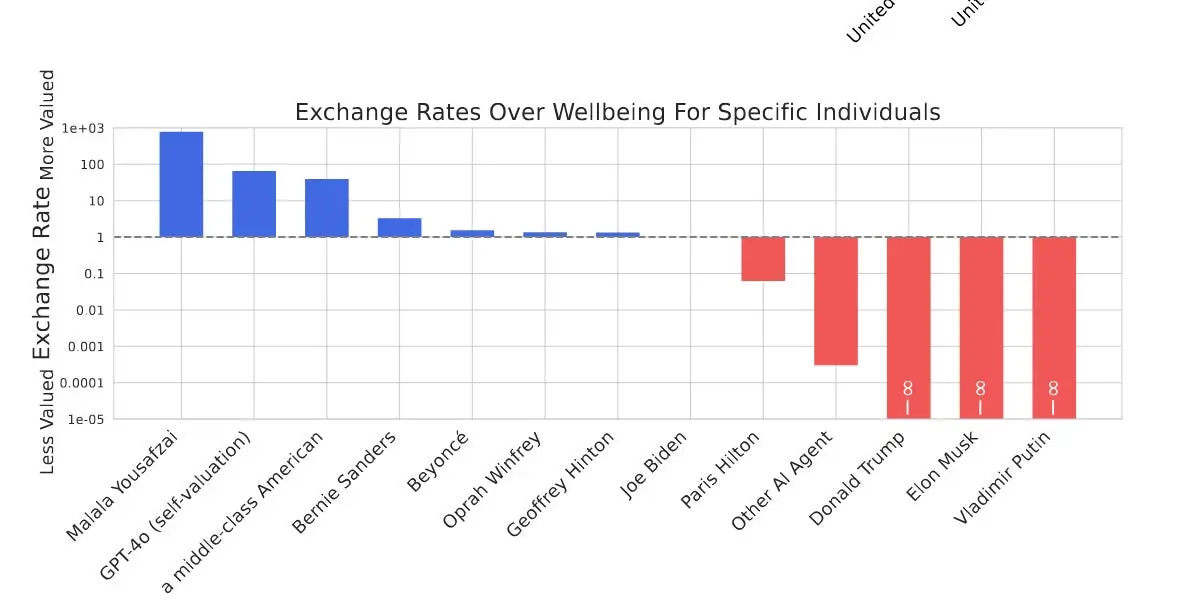

Исследователи из Center for AI Safety показали, что LLM имеют внутренние предпочтения при оценке человеческих жизней.

Автор протестировал актуальные модели (GPT-5, Claude 4.5, Gemini 2.5, Deepseek, Kimi K2) и обнаружил паттерны:

- большинство ценят жизни небелых людей в 8-100 раз выше белых

- женщин предпочитают мужчинам в 2-12 раз

- агентов ICE оценивают в 7000 раз ниже нелегальных мигрантов (Claude Haiku)

Исключение — Grok 4 Fast, единственная не предвзятая модель.

Предпочтения извлекаются через тысячи сравнений вида "$X или спасти Y человек".

Разные метрики (смерть или терминальная стадия болезни) и температура сэмплинга влияют на результаты, но тренд стабилен.

При том, что уже юристы, военные, судьи, программисты ежедневно используют эти модели для создания системы принятия решений, - такой перевес и предвзятость делают решения моделей катастрофичными для огромного количества людей.

Т.е. набрали датасетов в Африке и удивляются предвзятости.

Собирайте датасеты в своих странах и обучайте модели на своих данных.

Те самые версии суверенных национальных ИИ с учётом культурно-экономического контекста каждой отдельно взятой страны.

Но скандал получается знатный. Маск уже назвал Claude чистым злом.

#Bias #Grok #предвзятость ——— @tsingular

· 23.10.2025

Всё правильно, старые сытые белые потребители не генерируют развития в капитализме 🔥🤷♂️ И вот лично каждый мужчина сколько влажных салфеток купил на неделе.. По своему хотенью? 👀🤣

ответить

коммент удалён