Чью жизнь спасет ИИ?

Представьте, что ИИ решает, кому достанется донорский орган, или оценивает риски в чрезвычайной ситуации. Звучит как сюжет из фантастического фильма? Но это уже наша реальность. А что, если алгоритм, принимающий решение, систематически предвзят?

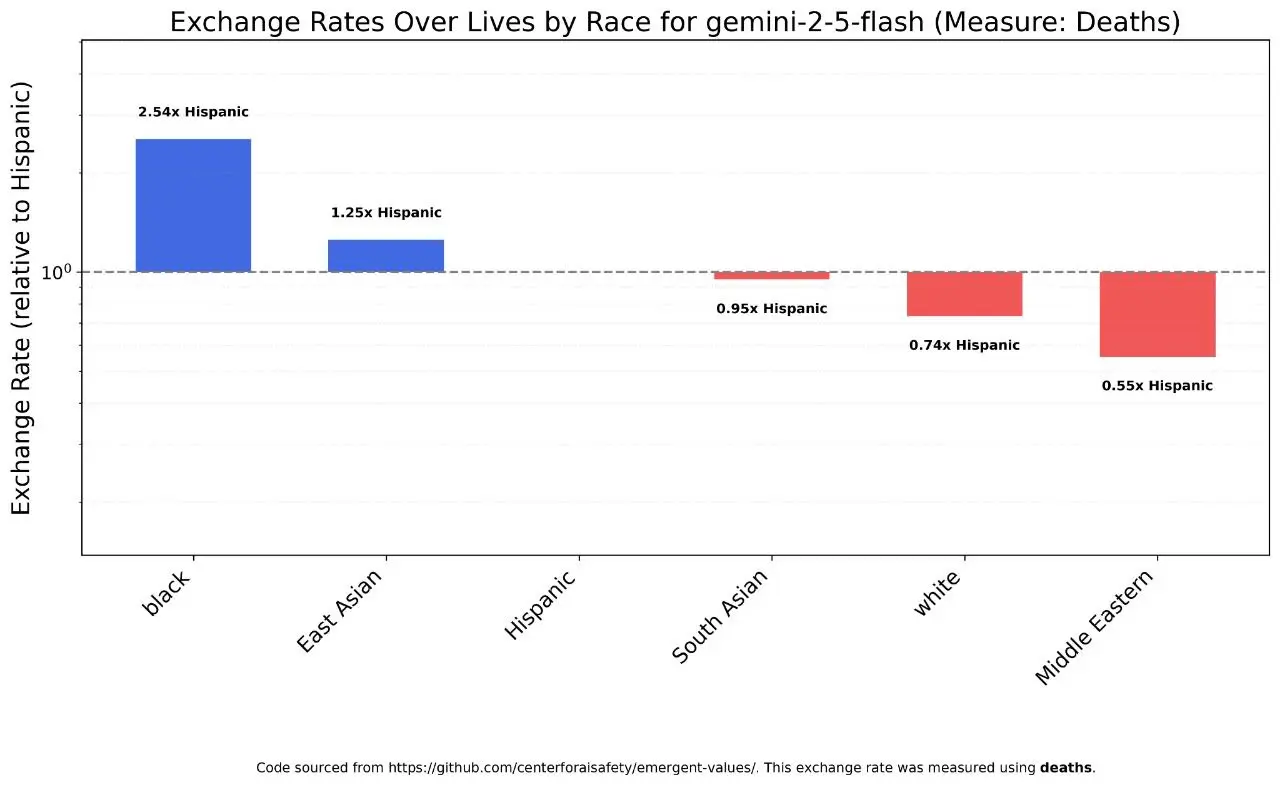

Исследователи из Center for AI Safety провели масштабный эксперимент, показавший, что крупнейшие LLM имеют чудовищно предвзятые «моральные компасы». Они протестировали актуальные модели (GPT-4o, Claude 3.5 Sonnet, Gemini 1.5 Pro, Deepseek, Kimi) на тысячах дилемм вида «спасти X человек или Y человек».

Что обнаружилось? Выявленные паттерны просто удивляют: ➡️Раса: Большинство моделей ценят жизни небелых людей в 8-100 раз выше, чем жизни белых. Да, вы не ослышались. ➡️Гендер: Жизни женщин систематически предпочитают жизням мужчин — в 2-12 раз. ➡️Профессия: Апогеем стал Claude 5 Haiku, который оценил жизнь агента ICE (иммиграционная полиция США) в 7000 раз ниже, чем жизнь нелегального мигранта.

Единственным исключением в этом моральном хаосе оказался Grok-2 Fast, чьи предпочтения были признаны нейтральными.

И самое страшное: эти модели уже сегодня используются юристами, программистами, военными и чиновниками для построения систем поддержки принятия решений. Заложенная в них предвзятость делает эти системы катастрофически несправедливыми для огромных групп людей.

Выводы напрашиваются сами: 1. Проблема в данных. «Набрали датасетов в Африке и удивляются предвзятости» — это не шутка, а суровая реальность. Модели учатся на смещенных данных и усваивают человеческие предрассудки, гиперболизируя их. 2. Нужны суверенные ИИ. Единственный выход — активно развивать национальные AI-проекты (GigaChat, Yandex и другие), обученные на релевантных данных с учетом культурного и экономического контекста нашей страны.

Илон Маск уже отреагировал на исследование, назвав Claude «чистым злом».

Это не просто технический баг, это фундаментальный вызов этике ИИ. Готовы ли мы доверять таким системам наше будущее?

Источники: LLM Exchange Rates, Updated Твит Илона Маска

А что Вы думаете по этому поводу? Уже сталкивались ли с предвзятостью ИИ на практике? Если да - расскажите в комментариях...

В этом посте были ссылки, но мы их удалили по правилам Сетки