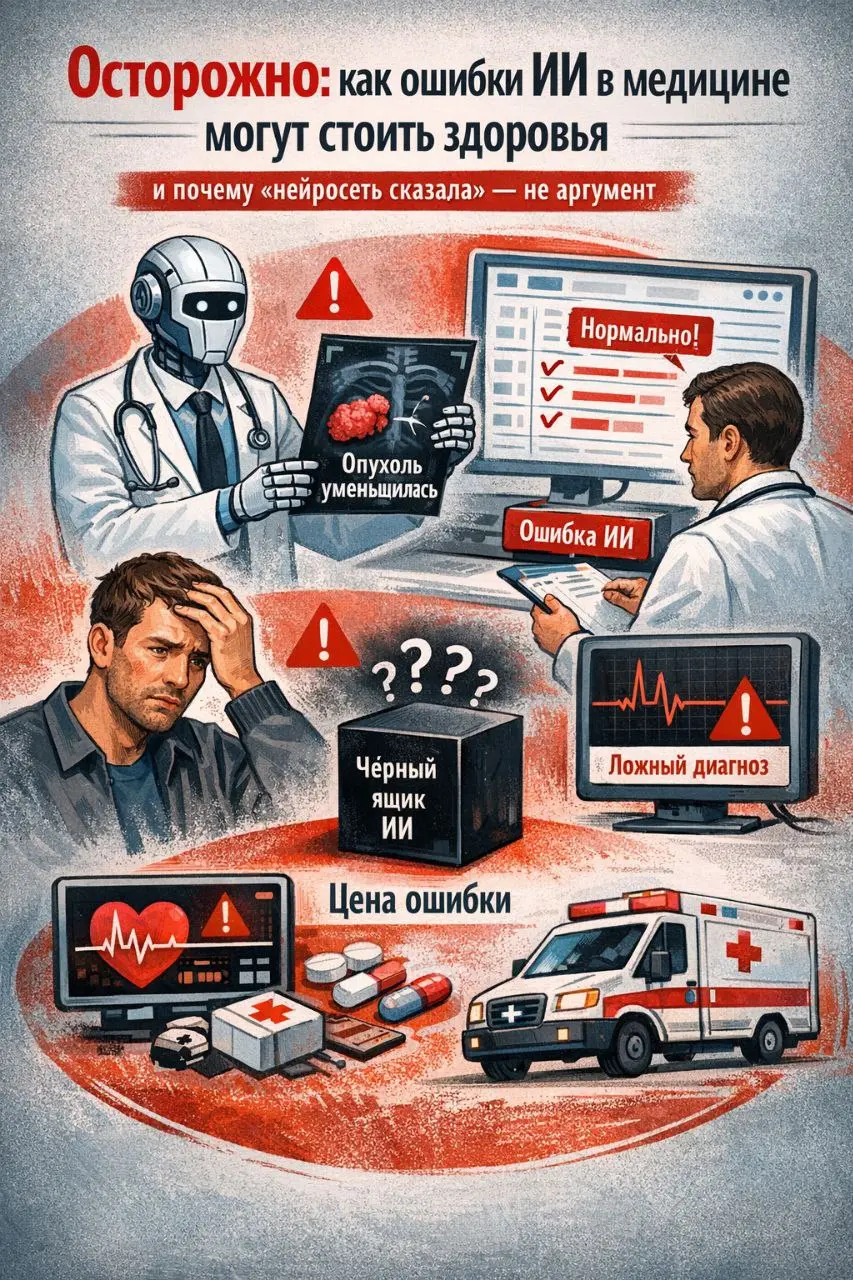

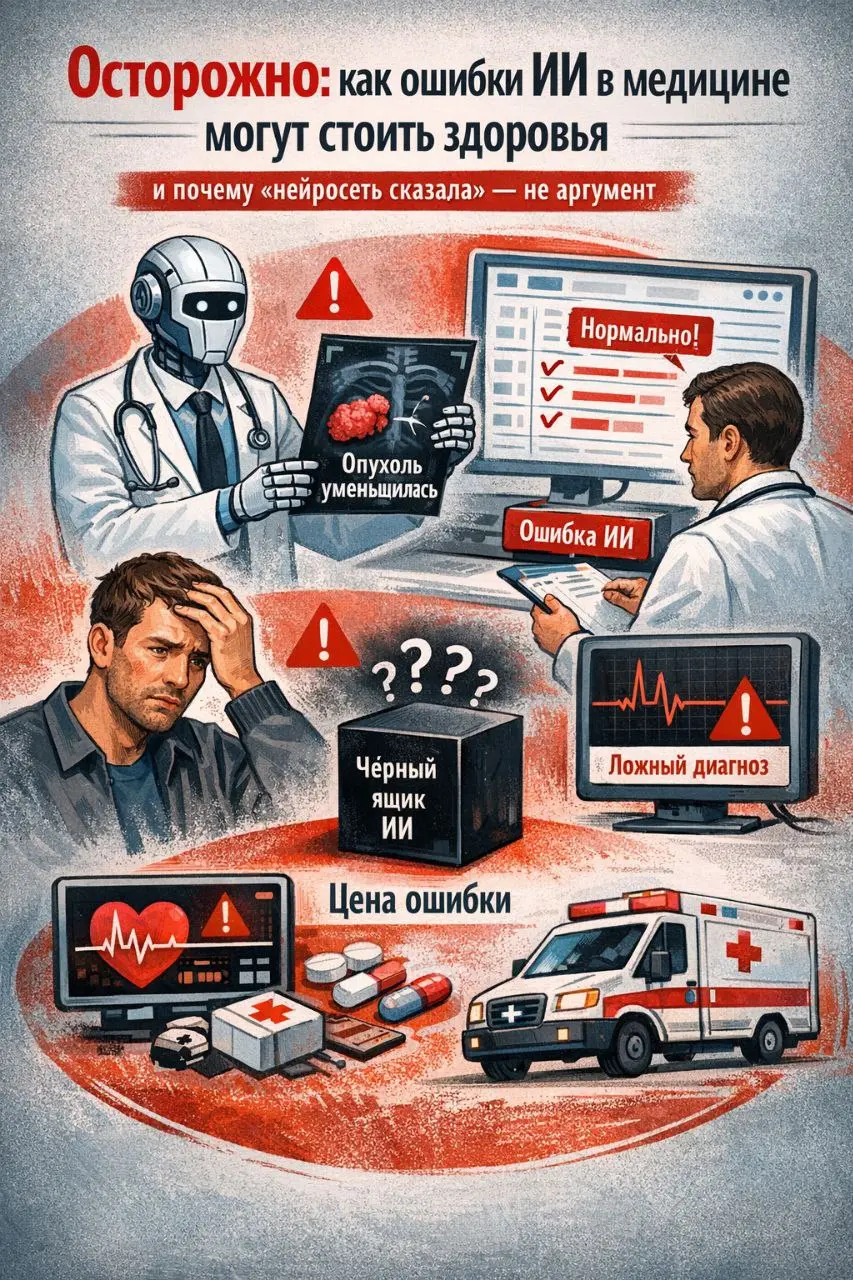

Осторожно: как ошибки ИИ в медицине могут стоить здоровья (и почему «нейросеть сказала» — не аргумент)

Привет! Мы часто пишем о прорывах ИИ, но сегодня — важное предупреждение. Когда генеративный ИИ ошибается в развлекательном контенте — это досадно. Когда он ошибается в медицине — это опасно для жизни.

Всего за последние месяцы произошла целая серия тревожных инцидентов: ➡️Google удалила AI-сниппеты с анализами крови. Расследование The Guardian показало, что ИИ-ответы по запросу «нормальный диапазон показателей печени» давали неточные числовые значения, не учитывали пол, возраст и могли создать у пациента с серьезным заболеванием ложное ощущение благополучия. Это назвали «опасным и тревожным». ➡️Perplexity ошиблась в онкодиагностике. В эксперименте нейросеть сравнила два КТ-снимка пациента с метастазами. Первый ответ гласил, что опухоль уменьшилась. После уточнения ИИ выдал противоположный вердикт — прогрессирование. Только врач смог дать верное заключение. ➡️Проблемы в московских поликлиниках. Пациенты жалуются, что врачи, работая с системой поддержки решений «ТОП-3», иногда некритично соглашаются с её предварительным диагнозом. Описаны случаи ложноположительных диагнозов (например, ишемическая болезнь сердца), которые позже не подтверждались. Почему так происходит? Главные причины ошибок 1. «Галлюцинации» и уверенная ложь. ИИ, особенно общего назначения, может генерировать убедительно звучащий, но полностью выдуманный ответ, особенно если в запросе есть неточность. 2. Проблемы с данными для обучения. Качество ИИ зависит от данных. Если выборка неполная, нерепрезентативная или содержит искажения (например, публикуются в основном «положительные» исследования), алгоритм унаследует эти ошибки.3. Эффект «чёрного ящика». Даже разработчикам не всегда понятно, как сложная нейросеть пришла к конкретному выводу, что затрудняет поиск и исправление системных сбоев. 4. Человеческий фактор. ИИ может повторять и даже усиливать когнитивные искажения, свойственные людям (например, эффект формулировки). А врачи, перегруженные работой, могут чрезмерно доверять алгоритму, отключая своё клиническое мышление.

Что делать? Простые правила безопасности ➡️Для всех: Любой ИИ-совет по здоровью — лишь отправная точка для разговора с врачом, не руководство к самолечению. ➡️Для медиков: ИИ — инструмент поддержки, но не замена экспертизе. Окончательное решение и ответственность всегда остаются за специалистом. ➡️Для разработчиков: Нужна максимальная прозрачность, валидация на реальных клинических сценариях и чёткое указание на ограничения продукта.

Вывод: ИИ — мощный помощник в медицине, способный анализировать огромные массивы данных. Но слепая вера в него так же рискованна, как и его полное игнорирование. Ключ — в разумном сочетании технологий и человеческого опыта, критического мышления и проверок.

А Вы сталкивались с явными ошибками ИИ в вопросах здоровья? Доверяете ли вы таким сервисам? Обсудим в комментариях.

#ИИ #искусственныйинтеллект #медицина #здоровье #безопасность #диагностика #DigitalHealth

В этом посте были ссылки, но мы их удалили по правилам Сетки