Ollama выходит на новый уровень: теперь она генерирует изображения локально 🚀

Знаменитый фреймворк для локального запуска больших языковых моделей (LLM) совершил серьезный прыжок в сторону мультимодальности. С недавним обновлением Ollama получила экспериментальную поддержку генерации изображений, превратившись из «запускалки» для чат-ботов в полноценный локальный AI-хаб.

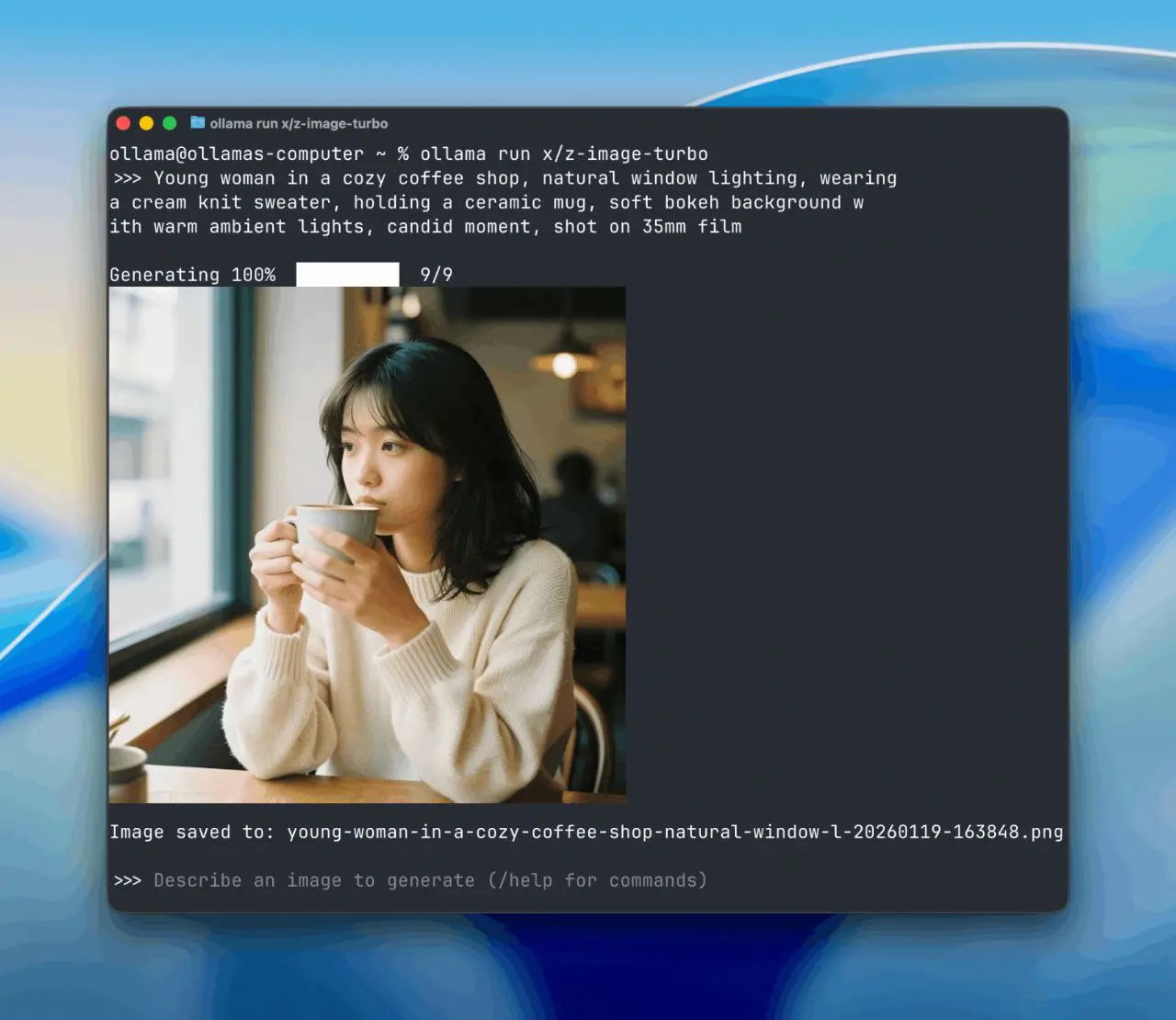

Что нового? ➡️Две новые модели: для старта доступны Z-Image Turbo (6 млрд параметров, для детализированных изображений) и FLUX.2 Klein (4/9 млрд параметров, для скорости). ➡️Работа через терминал: главная «фишка» — глубокая интеграция. В поддерживаемых терминалах (Ghostty, iTerm2) картинки можно просматривать прямо в консоли, а управлять генерацией — через CLI-команды. Идеально для пайплайнов и автоматизации. ➡️Локальность и приватность: всё работает на вашем устройстве. Никаких облачных подписок, API-ключей и отправки данных на сторонние серверы.

Важный нюанс: на данный момент функция доступна только для macOS. Поддержку Windows и Linux разработчики обещают добавить позже.

Это обновление — большой шаг к тому, чтобы собрать весь необходимый AI-инструментарий у себя на компьютере, сохраняя полный контроль и конфиденциальность данных.

Как думаете, для каких задач в первую очередь пригодится эта новая возможность? Делитесь идеями в комментариях!

https://ollama.com/blog/image-generation

#Ollama #ИскусственныйИнтеллект #AI #ЛокальныйAI #Нейросети #ГенерацияИзображений #Мультимодальность

В этом посте были ссылки, но мы их удалили по правилам Сетки