LLM в Почте

Ни одной лишь офлайн-сетью един мой департамент, поэтому хочу рассказать, о том, что моя команда сделала в рамках развития контакт-центра Почты России

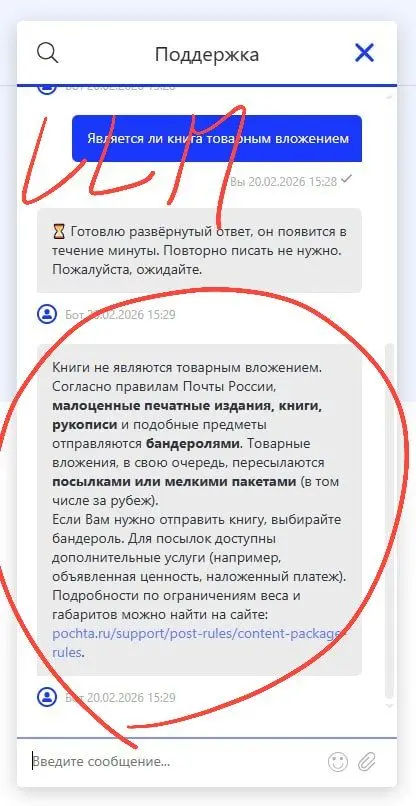

12 февраля мы запустили пилот LLM для ответов в клиентском чате на pochta.ru.

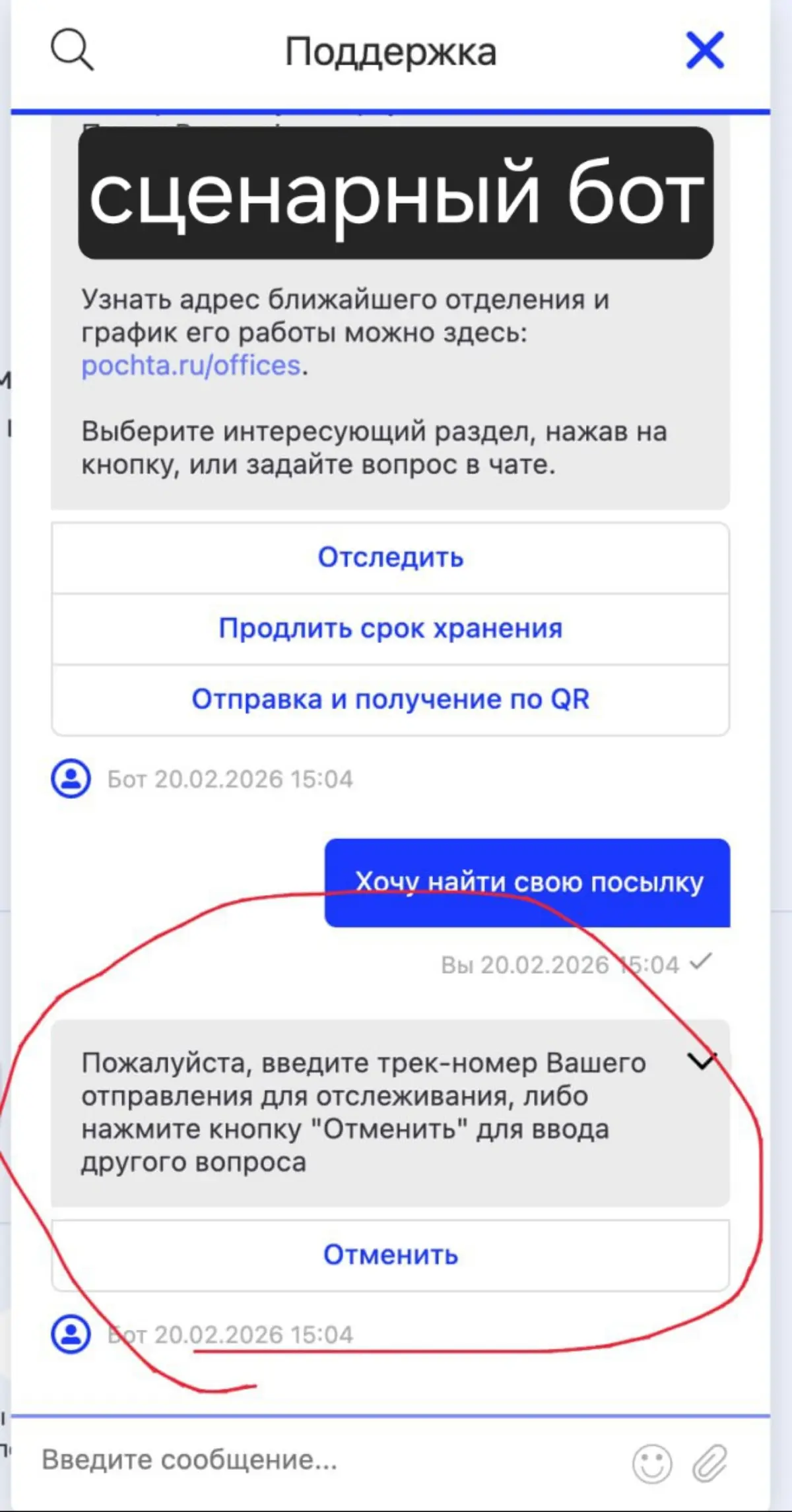

Мы пошли от самого безопасного сценария: модель подключается только к тем обращениям, где сценарный чат-бот не смог помочь. Дальше - анализирует контекст диалога, использует RAG на базе нашей БЗ и умеет обращаться к инструментам (трекинг, адреса и график работы отделений).

Взяли за основу Qwen3-32b. Развернули на наших серверах

(Попробовали модельку помощнее (Qwen3-Next-80B-A3B) поставить (в разы скорость ответа и качество улучшить) - к сожалению не встала)

Первые дни дали сразу два набора выводов.

Что уже работает и выглядит перспективно: 1. ответы точнее держат контекст и нюансы диалога; 2. заметно растёт доля автоматизации без «деревянных,ии-шных формулировок» ; 3. LLM хорошо подстраивается под ситуацию клиента. 4. умеет в инструменты отслеживания отправлений и адреса-графика. работы отделений.

Что нужно дожимать: 1. производительность (скорость ответа критична для качества в чате) сейчас может думать до 30 секунд; 2. роцесс регулярных улучшений промптов и базы знаний на реальных диалогах - с понятными правилами, метриками и контролем качества.

Отдельно хочу поблагодарить коллег из Департамента дистанционного обслуживания, Дирекции поддержки клиентов и развития сервиса

А самая большая благодарность руководителю проекта - Татьяне Менделеевой. На свои плечах протащила и запустила это процесс (а в рамках Почты, скажу, что это очень не просто)

Мы только начинаем. Stay tuned

P.s. можете зайти, потестить и вернуться с фидбэком

· 05.03

А почему выбор пал на Qwen? Рассматривали другие варианты?

ответить

коммент удалён