Как работает нейросеть за 5 минут. Начало

Всем привет!

Много последнее время пишут про нейросети и искусственный интеллект в целом, что, согласен, набило сильную аскомину. И я этим грешу, чего говорить 😅

Однако, среди бесконечных статей и постов периодически вижу налет магического мышления на то, как работает типичная нейросеть, генерирующая ответы (так называемый трансформер, или GPT - generative pre-trained transformer - генеративный предобученный трансформер), что сильно препятствует пониманию истинной сути технологии.

Чего только не пишут: от того, что GPT можно применить, где угодно, и что это скоро заменит множество профессий, до того, что эта технология аж поработит человечество.

Хочу в небольшой серии постов развеять эти мифы. Покажу, что любой GPT по своей сути - это огромное множество простых математических операций. А они сами по себе явно не могут никого заменить, - можно выдыхать, мы сложнее 😅

Давайте начнём, и сегодня у нас будет

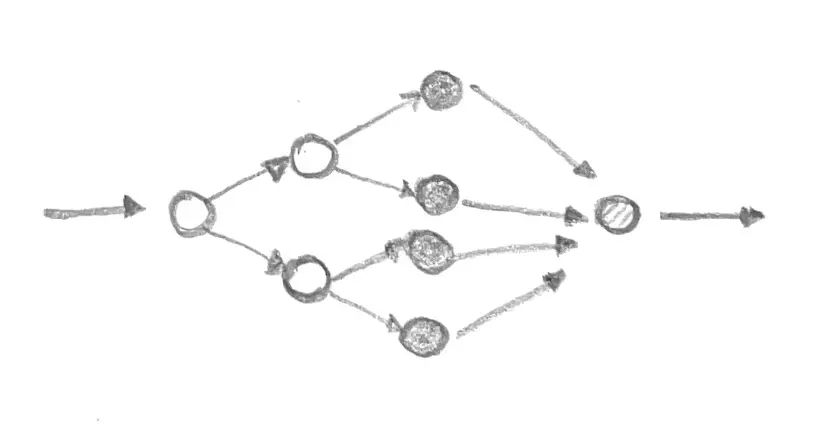

Концептуальное устройство любого GPT

Итак, вы открыли вашу любимую нейросеть и написали вопрос или закинули некий промпт.

Что происходит дальше?

Первый этап вычислений - токенизация и составление матрицы

1️⃣ Написанное вами разбивается на части - так называемые токены. Это могут быть как отдельные слова, так и части слов. Каждому токену из словаря модели подбирается математическая величина (вектор или ещё говорят «эмбеддинг», например, это выглядит вот так: [0.1, 0.2, -0.04, …]). За токенизацию отвечает отдельная часть системы - токенизатор.

2️⃣ Слова собираются как бы в стопку или таблицу (или математически - матрицу) - друг под другом в строку записываются векторы слов.

3️⃣ Поскольку слова стоят в предложении на нужных местах, то в матрицу для каждого слова добавляется указание его позиции - специальная величина, которая может быть как рассчитываемая, так и фиксированная. Её называют позиционный код. Это нужно, чтобы сохранить исходный смысл предложения.

Готово! Первый этап завершен 🙌

Токенизатор в GPT превратил то, что человек воспринимает умом

▶️ как буквы и их сочетания как слова, ▶️ составленные в предложения,

в последовательность выражений вида

{ (вектор слова 1, позиция слова 1), (вектор слова 2, позиция слова 2), и так далее },

с которыми далее работает модель. Можно образно назвать первый этап переводом с человеческого на математический 😅

Отмечу, что словарь модели составляется в процессе ее тренировок. Чем больше размерность вектора (по-простоту, чем длиннее выражение [0.1, 0.2, -0.04, …], соответствующее каждому слову) и чем больше таких «слов» в словаре, тем ответ модели глубже, точнее и интереснее.

Далее самое интригующее - собственно сама «магия» - то, как путем нехитрых, но повторенных сотни раз простых, почти арифметических, операций мы видим текст - собственно, ответ модели.

Дисклеймер

Специально опускаю сложные математические представления. Не претендую на первенство и уникальность в описании работы - уверен, что кто-то уже это делал и не раз. Мои источники - популярные статьи и общение с популярными на сей день моделями. Но очень хочется показать само сердце GPT, снять налет магии и открыть красоту математики и технологий.

Подписывайтесь, чтобы не пропустить ☺️

Ставьте лайк 💜 если полезно 🙌

· 03.03

Спасибо за публичное развенчивание всемогущества ИИ*, но всё-же заменить он может и уже заменяет.

ответить

коммент удалён