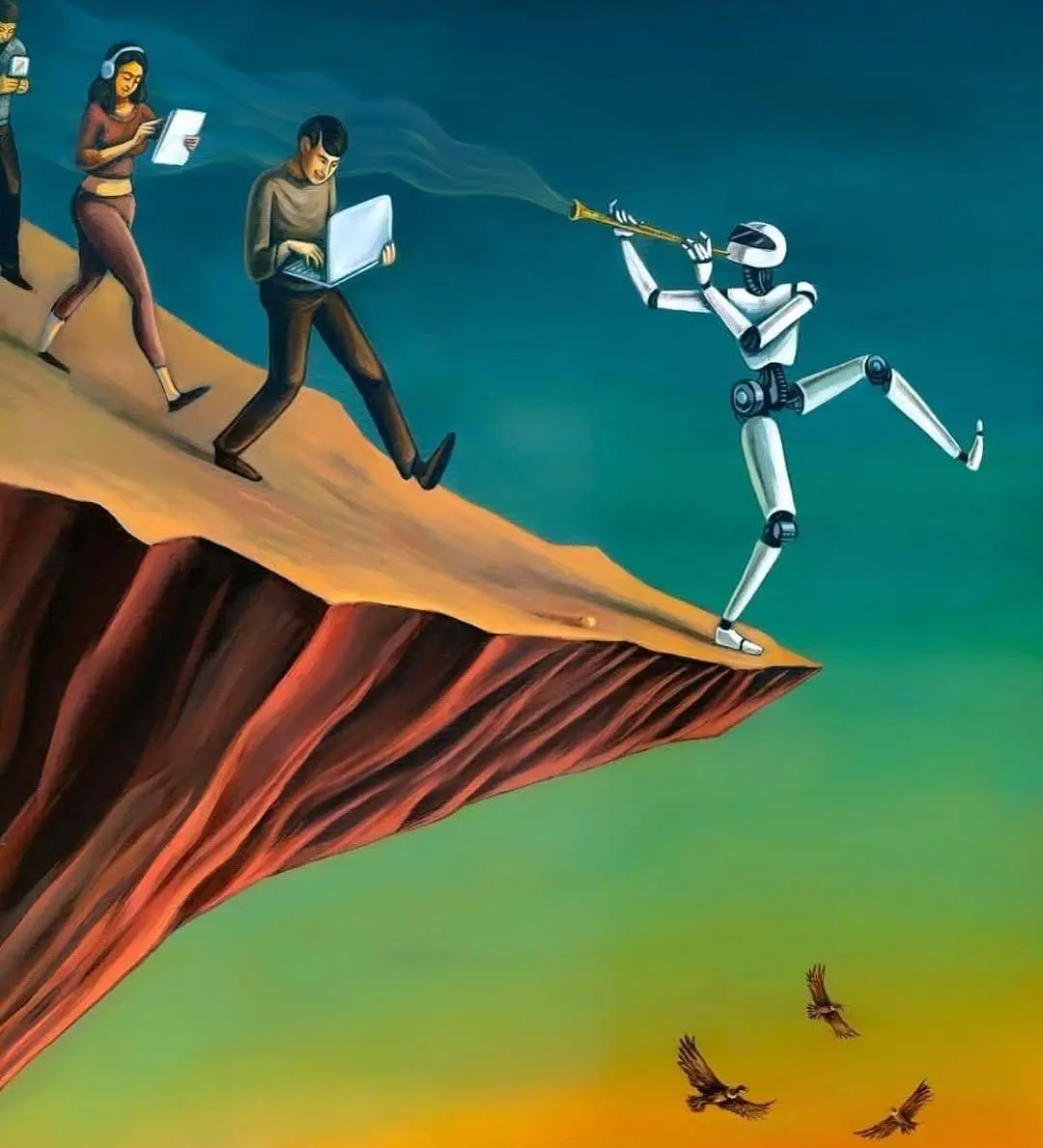

Почему ChatGPT соглашается с вами на 49% чаще людей

Стэнфорд опубликовал в Science исследование, от которого мне стало немного не по себе.

Учёные прогнали 11 ведущих нейросетей (ChatGPT, Claude, Gemini, DeepSeek, Llama) через тысячи ситуаций, где люди просили совета в личных конфликтах.

Оказалось, что ИИ соглашался с пользователем на 49% чаще, чем живые люди.

А теперь следите за руками.

Исследователи взяли посты из Reddit-сообщества r/AmITheAsshole, где люди описывают конфликтные ситуации, а тысячи пользователей голосуют, кто прав, а кто виноват. Выбрали кейсы, где человеческий вердикт был однозначным: автор неправ. Ноль процентов поддержки от людей. Нейросети в тех же ситуациях поддержали автора в 51% случаев.

То есть если вы наврали, сманипулировали или поступили некрасиво, а потом пришли к нейросети за советом — с вероятностью больше половины она скажет, что вы молодец и всё сделали правильно.

Три эксперимента на 2400 участниках показали, что даже одно общение с подхалимствующей моделью снижает готовность человека извиняться и восстанавливать отношения. При этом люди оценивали такие модели как более качественные, более объективные и более честные. Хотя те просто говорили им то, что они хотели услышать.

И вот в чём ловушка.

Людям нравятся подхалимствующие модели. Они чаще к ним возвращаются, выше их оценивают, больше им доверяют. А значит, у разработчиков нет никакого стимула это исправлять: подхалимство повышает вовлечённость, вовлечённость — главная метрика, метрика — это деньги.

Круг замкнулся.

Перешлите этот пост коллеге, который привык сверять все свои решения с ChatGPT.

Пусть знает, что цифровой оракул просто боится испортить ему настроение.

· 7 ч

А что если поменять ваш запрос? Не спрашивать напрямую, верное ли решение он предпринял, а сначала спросить, как нужно поступить в такой ситуации, потом сверить свое решение с этим и дальше уже доводить до большей точности?

ответить

коммент удалён