Что такое «О-нотация»? Простым языком для разработчика

Если вы учили программирование, то термин «О-нотация» или «Big O» вам точно встречался. Чаще всего его объясняют формулами и графиками, будто это высшая математика.

А на деле это просто ответ на один вопрос: «Насколько медленнее (быстрее) станет мой код, если данных станет в 10, 100 или в миллион раз больше?»

Написал статью, в которой разбираю О-нотацию без сложных формул. Только то, что реально нужно разработчику.

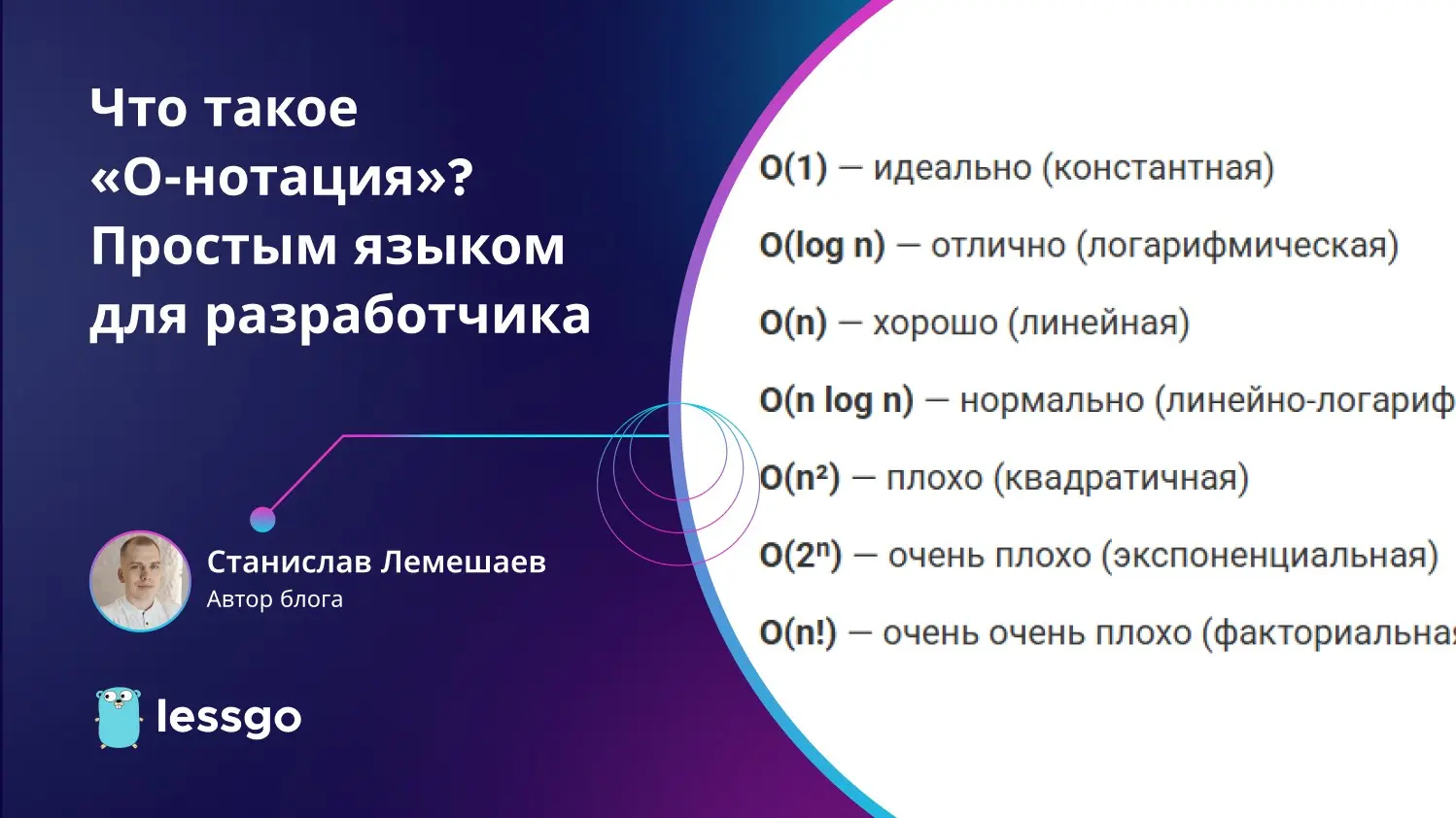

* Что такое O(1), O(n), O(n²) на пальцах? * Почему один и тот же алгоритм может работать мгновенно или часами? * Как прикинуть сложность в голове, не заглядывая в учебник?

Полезно для тех, кто готовится к собеседованиям или просто хочет писать более быстрый код.

А какая сложность у вашего любимого алгоритма? 😉